Kan AI-agenter lösa dina tillgänglighetsutmaningar?

Tillgänglighet är lagstadgat, men långt ifrån enkelt att få till i praktiken. Många verksamheter upptäcker för sent att testerna inte har varit tillräckligt bra, och att felen är fler än de trodde. Kan AI-agenter vara nyckeln till att täppa till det här gapet?

I den här artikeln tittar vi närmre på hur AI-agenter utmanar sättet vi testar tillgänglighet på – vad de faktiskt är bra på, var de brister och hur de bäst kan användas tillsammans med automatiserade och manuella tester.

Tillgänglighet handlar om mer än regelefterlevnad

Tillgänglighet handlar om så mycket mer än att undvika sanktioner från tillsynsmyndigheter. Det handlar om att bygga lösningar som i grunden fungerar för alla, oavsett funktionsförmåga.

Att implementera god tillgänglighet i webblösningar kräver rätt kompetens och bra verktyg. Alla roller i ett utvecklingsprojekt – designers, utvecklare och testare – behöver ha kunskap om tillgänglighet. Under utvecklingens gång måste lösningarna testas av både maskin och människa.

Två etablerade metoder – med tydliga begränsningar

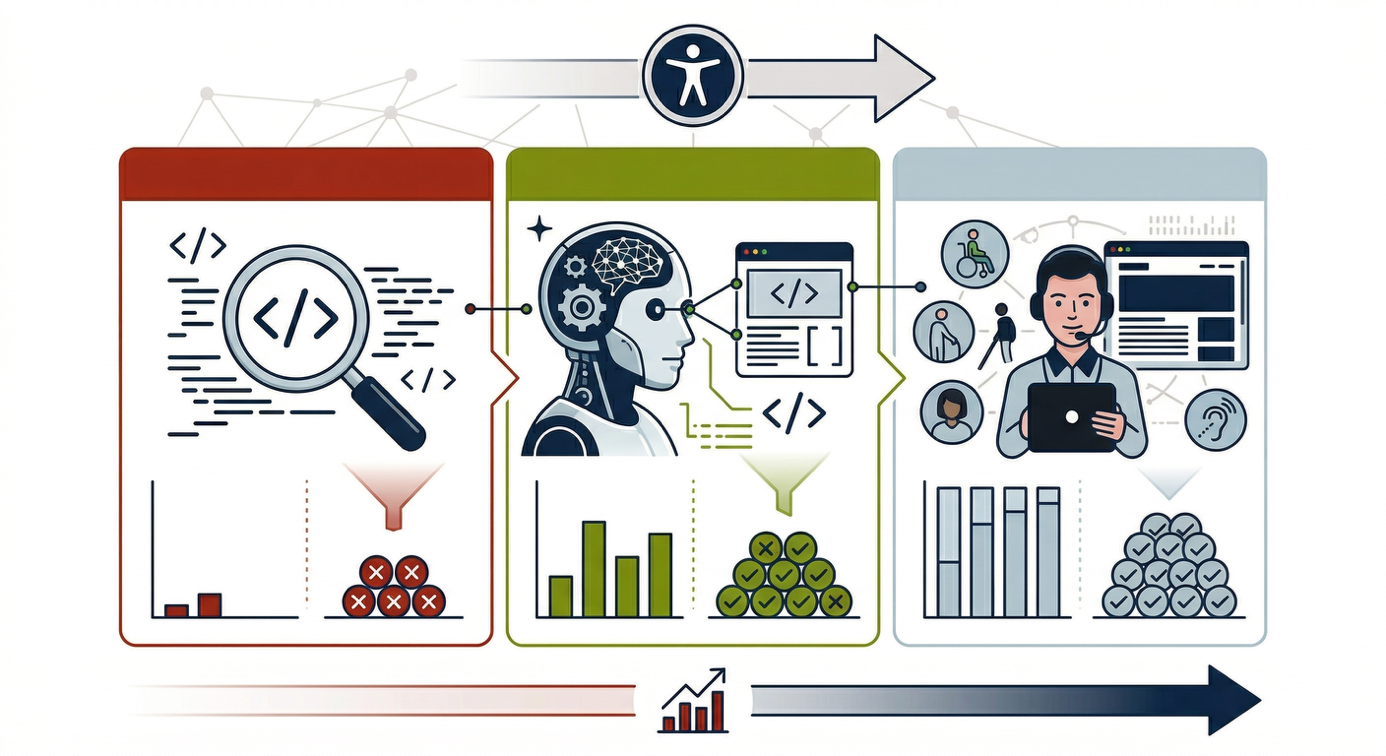

Traditionellt har tester delats in i två typer: automatiserade och manuella tester. På senare tid har introduktionen av AI-agenter gjort det möjligt att utöka de automatiserade testerna och ta över vissa delar av de manuella. En AI-agent bidrar alltså till att överbrygga gapet mellan dessa två metoder.

För att förstå värdet av AI-agenter behöver vi se hur de fungerar som ett komplement till de metoder vi redan använder:

Automatiserade tester: Snabba, men ytliga

De blixtsnabba automatiserade testerna är enkla att integrera, men de kontrollerar i huvudsak bara strikt tekniska syntaxfel. Branschdata visar att de ofta bara fångar upp 20–30 % av potentiella tillgänglighetsproblem.

De kräver dessutom kontinuerligt underhåll vid kodändringar och har svårt att hantera dynamiska element. Mer avancerade tester, som exempelvis Playwright och Chromium, kan simulera interaktion till viss del – men de måste kodas och behöver ofta justeras när till exempel strukturen i en popup-meny förändras.

Manuella tester: Grundliga, men resurskrävande

Manuella tester som utförs av människor ger en helhetsbild och fångar upp fel i rätt kontext. Därför är de det enda sättet att säkerställa att en lösning faktiskt fungerar bra och upplevs som logisk för användaren.

Nackdelen är att det kräver specialistkompetens att genomföra dessa tester och att utvärdera mot WCAG-kraven, vilket gör dem både tidskrävande och kostsamma.

AI-agenter: Ett nytt lager i teststrategin

AI-agenter fyller gapet mellan automatiserade och manuella tester. Kort sagt rör vi oss nu från statiska testscripts till smarta, autonoma AI-agenter.

Medan traditionella tester enbart granskar kod för tekniska regelbrott kan AI-agenter i mycket större utsträckning simulera en användare med nedsatt funktionsförmåga och interagera med gränssnittet. De förstår både den visuella och logiska kontexten på skärmen och dokumenterar upptäckta fel med förklaringar – de kan till och med föreslå konkreta kodändringar direkt till utvecklare.

Illustration: AI-genererad bild som illustrerar AI-agenter som genomför automatiska tester.

Fördelarna: Ökad testtäckning och mindre manuellt arbete

Att låta AI-agenter bistå i projekt ger flera tydliga fördelar:

-

AI fångar upp fler logiska och visuella fel som traditionella verktyg missar, vilket ger högre total testtäckning.

-

Agenterna förstår innehållets syfte och kan till exempel avgöra bilders funktion. De kan skilja mellan dekorativa och informativa bilder, vilket är avgörande för att uppfylla WCAG 1.1.1.

-

AI-agenter är inte beroende av strikt determinism och hanterar förändringar i struktur bättre än traditionella, mer sköra interaktionstester. Resultatet blir mindre underhåll.

-

Istället för att lägga tid på manuell felsökning av triviala fel frigörs resurser som kan användas till verklig användartestning och kvalitetssäkring som förbättrar användarupplevelsen.

-

AI-agenter kan identifiera tillgänglighetsproblem kontinuerligt under utvecklingen, vilket minskar risken för obehagliga överraskningar vid leverans.

Begränsningarna: Därför kan AI inte stå ensam

Samtidigt är det viktigt att förstå begränsningarna – AI är inget universalmedel:

-

AI-agenter är inte alltid konsekventa, vilket kan göra dem svåra att använda i automatiserade CI/CD-pipelines eftersom resultaten kan variera mellan körningar.

-

En agent förstår bara det den är tränad eller instruerad att se. Den kan inte avgöra om funktionalitet saknas – en bedömning som kräver mänskligt omdöme.

-

AI kan inte garantera en bra helhetsupplevelse eller avgöra om ett gränssnitt “känns rätt” för en användare. Här behövs fortfarande människor.

-

I slutna miljöer med höga säkerhetskrav, eller i inloggade tjänster, kan det vara svårt att använda externa språkmodeller för analys.

Så kombinerar du människa, maskin och AI

AI-agenter kan ge stort värde – men som ett komplement. Framgångsfaktorn ligger i att låta maskinerna ta hand om det tunga grundarbetet, som felaktiga ARIA-attribut och kontrastproblem, medan människor fokuserar på manuell användartestning och kvalitetssäkring.

Riktig användartestning med olika skärmläsare kan inte ersättas av dagens AI-agenter. Det finns fortfarande ett tydligt behov av experter som kan skapa automatiserade tester och styra AI-agenter för att hitta rätt problem.

Hur vi kan hjälpa

På Accelerate har vi lång erfarenhet av att hjälpa både offentliga aktörer och privata företag att utveckla webblösningar med mycket höga krav på tillgänglighet.

Som nordiskt konsultbolag med över 250 specialister kombinerar vi teknisk expertis med affärsförståelse. Vi hjälper er att sätta upp en strategisk testmetodik där smarta AI-agenter, automatiserade scripts och ovärderlig mänsklig kompetens samverkar för att skapa bästa möjliga användarupplevelse.